Was passiert, wenn man sich intensiv mit KI zu beschäftigen beginnt? Man sieht überall nur mehr KI … Und man denkt neu über den Menschen und übers Lernen nach. So eine der häufigeren Feststellungen am 5. Juni im Rahmen der zweiten Thinktank-Runde.

KI-Flash – unter diesem Motto stand das Treffen diesmal. Darunter kann man sich all das vorstellen, was einen bislang in Sachen KI „geflasht“ hat – positiv, negativ … egal. Hauptsache: „Überwältigend-irre-megacool-wahnsinnig-unsäglich-unpackbar-zukunftsverdächtig-unglaublich-horizonterweiternd etc.“

Der Tag hat gezeigt, wie gewinnbringend für die Arbeit des KI-Thinktanks es war, einander gegenseitig in diesem Sinne KI-„Gipfelmomente“ ebenso wie „Tiefpunkte“: also Horizonterweiterungen und Geistesblitze aller Art mitzuteilen. Dieser Blog-Beitrag möchte in einige der Diskussionen, die sich entsponnen haben, ein Stück weit mitnehmen und anregen, sich eigenen Gedanken dazu zu machen. Und darüber hinaus gibt es eine lange Liste an Beobachtungen, die fürs weitere Vorgehen von Bedeutung für den Thinktank sein werden.

Vom Nutzen und Nachteil des Taschenrechners fürs Lernen

Gretchenfrage: Hat der Taschenrechner sich eher positiv oder negativ auf die Mathe-Kompetenzen ausgewirkt? Irgendetwas geht ja um Laufe der Zeit immer verloren (beispielsweise die breit gestreute Fähigkeit, mit der Hand Kühe zu melken …) – aber wie wichtig ist das, was verloren geht, tatsächlich?

Seit der Einführung von Schulbüchern (die vermutlich von dem einen oder anderen Seufzen über den Verlust von Merkfähigkeit bei den Schüler:innen begleitet war) ist der Taschenrechner die nächstgrößte technologische Innovation in den Klassenzimmern. Und damit vielleicht ein gutes Anschauungs- und Nachdenkbeispiel für das, was mit der breitflächigen Einführung von KI gewonnen (und verloren) werden könnte.

Höchstwahrscheinlich liegt die Antwort hier – wie so oft – in der Gestaltung einer neuen Kultur, die bewusst Nachdenken und Kopfrechnen mit den Möglichkeiten der Technologie verknüpft. Ich denke hier an meinen verstorbenen Physiklehrer, dessen Praxis darin bestand, den Fokus auf den rechnerischen Formelansatz zu legen, im Berechnen dann aber großzügig (nach dem Motto: 1=2=PI) zu kürzen, weil im Maßstab des Universums ohnehin nur die Größenordnungen, sprich: Zehnerpotenzen von Bedeutung wären … Für unsere Denkfähigkeit und unser Verständnis hat seine Methode jedenfalls tolle Beiträge geleistet (zumindest bei den meisten …).

Jedenfalls führten diese Überlegungen schnurstracks zur Frage, wie konkret kritisches Denken und Urteilsfähigkeit geübt und die Kultur des richtigen Maßes im Kontext von KI erreicht werden könnte. Diese „Aushandlung“ findet nicht an grünen Tischen, sondern in Wirklichkeit schon tagtäglich in vielen Klassenzimmern (mehr oder weniger bewusst) statt. Und wer sich diese Thematik in weniger als einer halben Stunde vor Augen führen möchte, ist mit diesem Video (Danke für den Tipp in die Thinktank-Runde!) sehr gut beraten.

Auch der Thinktank wird sich mit diesem Thema noch ausführlich auseinandersetzen. Aber davon weiter unten mehr.

KI „halluziniert“ immer! Oder was/wem man eigentlich noch glauben kann

Themenwechsel. In seinem ungemein klugen (und ungemein lesbaren) Buch Homo cyber. Ein Bericht aus Digitalien. stellt der österreichische Informatiker Peter Reichl (S. 47f) lapidar fest:

„ChatGPT halluziniert aus Prinzip, immer und überall, und deshalb kann und sollte man sich darauf nicht, niemals und nirgendwo verlassen.“

Wir wären also beim Thema Vertrauen angelangt. Und beim Aufbau dieses Vertrauens. Damit ist auch eine der Schwachstellen des Großteils der aktuell geführten KI-Debatten angesprochen, die sich meist um den Umgang von mündigen Erwachsenen mit KI drehen. Wie sieht es aber mit Minderjährigen, Unmündigen, Heranwachsenden, Orientierung erst Erarbeitenden aus?

Jedes Kind ist zuerst einmal darauf angewiesen, demjenigen bzw. denjenigen, die im etwas beibringen, zu vertrauen. Erst allmählich bildet sich ein „Rahmen“ und ein „methodisches Repertoire“ heraus, auf dessen Basis man dann Urteile fällen und Kritik üben bzw. neu und selbstständig Einordnen kann. Nicht zuletzt aus diesem Grund wird in jeder einigermaßen seriösen Debatte über die Sache auch immer wieder festgestellt, dass man im bzw. zum Umgang mit KI gar nicht genug wissen könne, um die Technologie verantwortungsbewusst einsetzen zu können. In ebendiesen Debatten wird regelmäßig KI als personalisierter Lernhelfer und möglicherweise „große ausgleichende Kraft“ für sozial Benachteiligte vorgestellt. Aber – siehe oben – wenn man ihr nicht vertrauen kann, der KI? Oder – etwas positiver gewendet – welcher KI kann man unter welchen Umständen vertrauen und sie tatsächlich als zeit- und ressourcensparende, ermöglichende „Hilfs-Lehrkraft“ zum Lernen einsetzen?

Mittlerweile ist ja nicht nur die „Halluzination“ von Chatbots ein hinlänglich bekanntes Phänomen; darüber hinaus muss man feststellen, dass KI „lügt und betrügt“. (Gedankenstrich: Kann Technologie „lügen und betrügen“? Beides wäre ja mit Intention verbunden. Was wiederum Personen auszeichnet. Eine Maschine ist aber keine Person, oder? Aber davon gleich mehr im folgenden Absatz …) Die vom ZDF recherchierte Geschichte der KI Cicero des Konzerns Meta zeichnet nach, wie – wider die Intentionen seiner Programmierer – die KI sich „foul play“ antrainiert hat, um zu gewinnen. Die Sorgen, sich von der KI die Kontrolle nicht aus der Hand nehmen zu lassen – zuletzt auch vom Papst im Rahmen des G7-Gipfels geäußert, sind also wohl nicht aus der Luft gegriffen.

Die Würde des Menschen ist unantastbar – und warum tut KI dann so, als wäre sie eine Person?

ChatGPT tut es. Gemini tut es. Siri und Alexa tun es schon lange. You und Perplexitiy sind da etwas zurückhaltender. My IA von Snapchat tut es besonders aufdringlich. Diese KI-Bots befleißigen sich einer Sprache und eines Auftretens, das eigentlich nur einer Person zukommen würde. „Wie kann ich dir heute helfen?“ „Ich hoffe, die Zeichnung entspricht deinen Vorstellungen.“ Wie kommt die Technologie eigentlich dazu, sich als „Ich“ zu bezeichnen? Bzw. – genauer gefragt – was führt deren Programmierer und Finanziers dazu, Technik im sprachlichen Gewand von Menschen auftreten zu lassen? Und missachtet dieses „Mimikri-Verhalten“ letztlich vielleicht sogar die menschliche Würde und verstößt damit – long shot, aber vielleicht eine interessante juristische Frage – gegen das deutsche Grundgesetz?

Solche Beobachtungen führen schnurstracks zur Frage der Zusammenhänge von KI mit den Menschenbildern der Macher, aber auch der Anwender:innen von KI. Sehr aufschlussreich ist beispielsweise der Ted-Talk von Mustafa Suleyman, der tief ins Weltverständnis eines wesentlichen KI-Protagonisten blicken lässt. Technikgläubigkeit vom Feinsten. Völlige Ignoranz aller Nebenwirkungen und offenen, demokratiepolitischen Fragen. Eine „toolgetriebene“ Sicht auf die Weltgeschichte, in der Begriffe wie Verantwortung, Erkenntnis, Denken, Verstand einfach nicht vorkommen. Bis hin – auf der Suche, nach passenden Metaphern, die KI erklären können – zum Satz: „AI isn’t seperate – AI is us: all of us.“ Wie bitte? Danke, aber nein danke. Ich persönlich zumindest will mich nicht einer Philosophie anschließen, die KI quasi „zur Seele“ der Menschheit erklärt. Und außerdem will ich mich von KI auch nicht duzen lassen. (Fragt sich nur: Wie „spricht“ man dann mit diesen Dingern?! Und ist diese meine persönliche Sensiblität vielleicht einfach ein Generationen- oder Altersthema?)

Die September-Session des KI-Thinktanks wird jedenfalls solchen und ähnlichen Fragen gewidmet sein. Und wir freuen uns darauf, bei dieser Gelegenheit gemeinsam mit Prof. Birte Platow, Religionspädagogin und Mitglied des Vorstands eines KI-Projekts der TU Dresden, nachdenken zu dürfen.

Große Worte gelassen aussprechend. Und Verschiedenes darüber hinaus …

Metacognition. Prozess- und Reflexionskompetenz. Urteilsfähigkeit. Autorschaft … Sechs Stunden intensiver Diskussion sind unmöglich in voller Länge in einem Blogbeitrag, der auch noch einigermaßen lesbar bleiben möchte, nachzuzeichnen. Aber abschließend soll zumindest aufgelistet werden, was „sonst noch“ bewegt hat und besprochen worden ist:

- KI muss als Leitungsthema erkannt werden. Schulleitung darf das Thema nicht ignorieren. Das ist leicht gesagt. Aber wie konkret gehe ich damit um? Der Thinktank überlegt, mit Ende des Jahres genau hier eine Strategie vorzuschlagen.

- KI ist – möglicherweise – auch ein Thema in der Schulverwaltung. Hier mehr Effizienz und Zeitersparnis zu Gunsten der Pädagogik zu erwirtschaften, klingt verlockend. Aber wie genau?

- Es muss noch viel geschehen – in Sachen Bildungs- und Chancengerechtigkeit.

- Die 4As von Doris Weßels (Aufklären – Ausprobieren – Akzeptieren – Aktiv werden) könnten ein handfester Beitrag zur mündigen Auseinandersetzung mit KI sein.

- Es ist die Mühe wert, mit Schüler:innen (und Kolleg:innen) in die kritische Auseinandersetzung mit KI zu gehen. Die KI-Ergebnisse blenden nicht selten beim ersten Hinsehen. Der zweite Blick und eine Runde gemeinsames Nachdenken führen tatsächlich weiter …

- Auch Baden-Württemberg hat mittlerweile ambitionierte KI-Unternehmen: Beispielsweise die Heilbronner IPAI oder die Heidelberger Aleph Alpha.

- KI ist mehr als ChatGPT – es ist notwendig, auch ein paar Grundbegriffe und Grundverständnis über das technische Funktionieren von KI aufzubauen.

- Welche (politischen und finanziellen) Forderungen müsste man an die Schulverwaltungen richten? Wäre ethisch vertretbare KI nicht auch eine Frage der Eigentümerschaft und damit der digitalen Souveränität?

- Christliche Schulen betrachten Einzigartigkeit als Vielfalt und Bildungsgerechtigkeit als verpflichtende Aufgabe. Was hieße das in Zeiten von KI?

- Für die rasche (und einführende) Lektüre zwischendurch empfiehlt sich Silke Müllers neuer Bestseller: Wer schützt unsere Kinder? Wie künstliches Intelligenz Familien und Schulen verändert und was jetzt zu tun ist.

- Und, last, but not least, es ist unglaublich, was KI beispielsweise im sonderpädagogischen Bereich an Möglichkeiten der Teilhabe und Selbstwirksamkeit generieren kann.

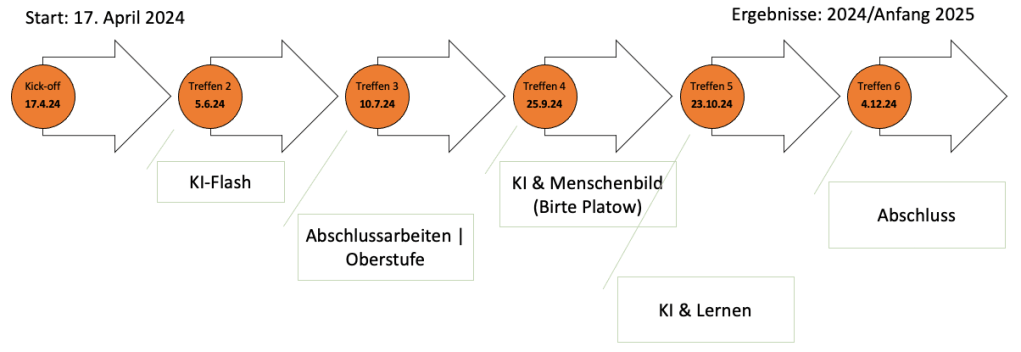

KI-Thinktank – der weitere Fahrplan

Und so geht’s weiter mit den kommenden Thinktank-Treffen.

- Das Meeting am 10. Juli wird der KI-Anwendung in der Oberstufe gewidmet sein. Insbesondere für Schüler:innen ab 16 führt kein Weg mehr vorbei an KI. Erstens sind die Jugendlichen ohnehin schon damit zugange. Zweitens werden sie sich als Erwachsene in einer Welt mit KI zurechtfinden müssen. Und drittens sind alle Schulen und Lehrkräfte gut beraten, einen konstruktiven und überlegten Umgang mit KI – zum Beispiel im Zusammenhang mit Abschlussarbeiten – zu finden. Der Termin wird sich – das Team ist diesmal verstärkt durch Oberstufen-Lehrkräfte, einige Schüler:innen sowie einigen Vertreter:innen von Unis mit einem Fokus auf Hochschuldidaktik – der konkreten Entwicklung einer (bestmöglichen) Handreichung und Vorgehensempfehlung widmen; mittlerweile kann man ja hier auf vielen, guten Vorarbeiten aufbauen.

- Am 25. September wird, wie schon weiter oben erwähnt, das Thema KI und Menschenbild im Fokus stehen. Wir schauen gemeinsam gewissermaßen unter die Oberfläche des alltäglichen „Kennst-du-schon-hast-du-schon-probiert?“ und überlegen, was einen christlichen Standpunkt gegenüber und Umgang mit KI bestimmen und auszeichnen könnte.

- Der 23. Oktober ist der Frage des Lernens mit, über und ohne KI gewidmet. Und zwar mit einem Fokus auf Grundstufe und Sekundarstufe 1 – der Oberstufe wird ja der 10. Juli gewidmet sein. Eine Überlegung geht in die Richtung, sich beispielsweise Unterrichtsvorschlägen mit Ki, die ja mittlerweile reichlich kursieren, kritisch zuzuwenden und zu überlegen, was genau und wie genau diese eigentlich zum Lernen führen. Und welche Theorien und Aspekte von Lernen hier angesprochen, besonders unterstützt oder aber auch elegant ignoriert werden. Diese Session soll und insbesondere zu Kriterien und Argumenten führen, wann und warum bzw. wann und warum nicht welcher KI-Einsatz für wen in Frage kommen kann. Nicht zuletzt um Fragen der Lern- und Prüfungskultur wird es hier gehen müssen.

- Das Finale am 4. Dezember lassen wir uns aktuell noch offen. Zum einen werden wir natürlich versuchen (siehe oben: KI-Strategie für Schulleitungen), Themen zu adressieren und zu finalisieren, die uns am gemeinsamen Denkweg schon begegnet bzw. entgegen gekommen sind. Zum anderen möchten wir uns auch Zeit freihalten für das, was wir bislang noch nicht verstanden, bedacht oder überhaupt in den Blick bekommen haben. Wir werden hier berichten. Und Sie können im Rahmen der Thinktank-Foren online live mit dabei sein.

Denn: Jedem Thinktank-Treffen folgt am Tag danach ein Thinktank-Forum online via Zoom. Die nächsten Foren finden also statt: 11. Juli, 26. September, 24. Oktober sowie 5. Dezember 2024, jeweils von 17:00 – 18:30. Interessiert? Melden Sie sich hier an – wir schicken Ihnen dann den Teilnahme-Link zu.

Im Übrigen hat die Gruppe eine Taskcards-Pinwand angelegt, die laufend erweitert wird. Beiträge, Fragen und Wünsche – auch ganz generelle zur Arbeit des Thinktank – richten Sie gerne an: aufsganze@esw-bw.de.